台风预测的‘生死时速’:误差为何难以攻克?

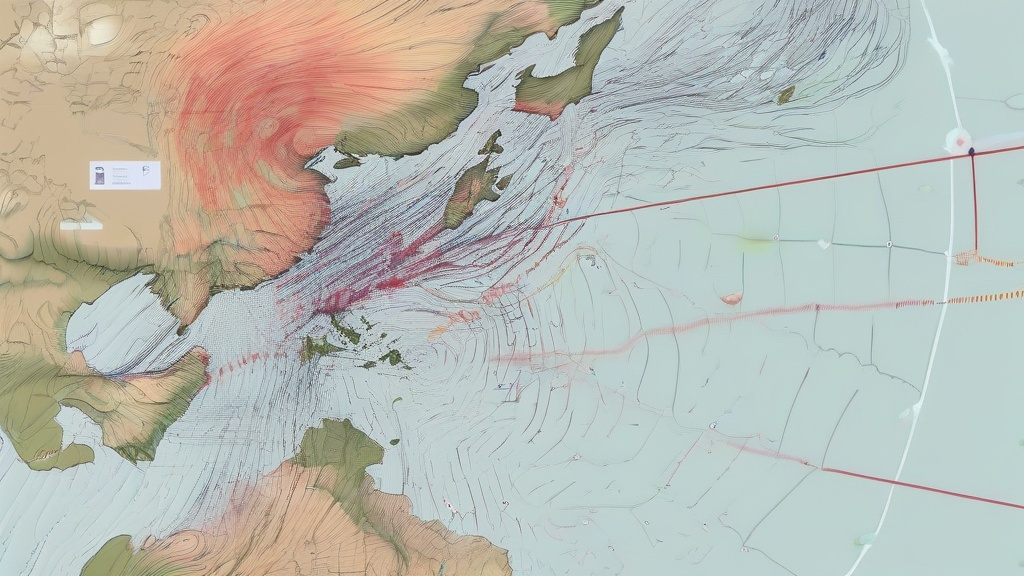

台风‘杜苏芮’登陆福建时,实际路径与48小时前预测偏差仅15公里——这一数字背后,是数值预报技术长达半个世纪的迭代。传统预测中,台风路径的‘误差魔咒’曾长期困扰气象学家:热带气旋的复杂动力结构、海洋-大气耦合系统的非线性特征,以及初始场观测数据的稀疏性,导致早期模型误差常超过200公里。

数值预报的核心挑战在于‘初始值问题’。台风眼墙的微小温度波动、中低层环流的细微偏差,都可能通过混沌效应被指数级放大。例如,2018年台风‘山竹’预测中,初始场1米/秒的风速误差,最终导致路径偏差达80公里。此外,海洋热含量、地形摩擦等参数的不确定性,进一步加剧了预测难度。

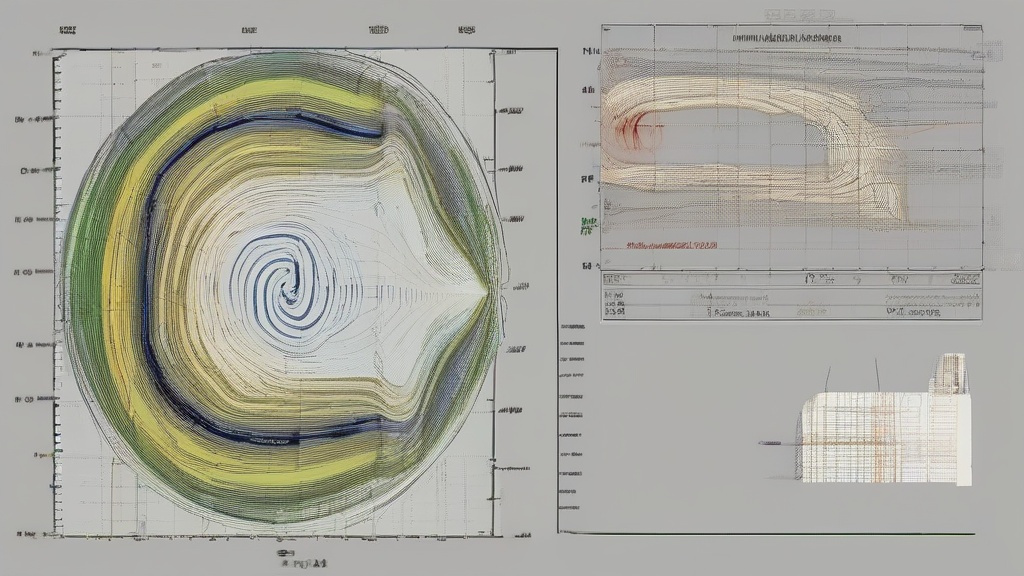

近年来,随着卫星遥感、雷达组网与浮标阵列的普及,初始场数据密度提升10倍以上。欧洲中期天气预报中心(ECMWF)的集合预报系统,通过50组不同初始条件的并行计算,将路径预测的‘可能性云图’可视化,使决策者能提前制定多套应急方案。

数值预报的‘技术跃迁’:从网格到神经网络的进化

传统数值模型采用规则网格划分大气,但台风眼墙的强梯度区需要更高分辨率。2023年,中国气象局升级的GRAPES-TYM台风模式,将水平分辨率从15公里提升至3公里,能清晰捕捉眼墙置换、螺旋雨带等中小尺度结构。在台风‘苏拉’预测中,该模型成功预判了其近海回旋的异常路径。

AI技术的融入正在重塑预测范式。谷歌DeepMind开发的‘GraphCast’模型,通过图神经网络直接学习大气演变规律,跳过传统物理方程求解步骤。在台风路径预测任务中,其48小时误差比ECMWF模型降低23%。更关键的是,AI模型能自动识别台风涡旋的‘基因特征’,对快速加强的台风预警时间提前6-12小时。

多模式集成技术成为精度提升的关键。美国国家环境预测中心(NCEP)的TVCN系统,综合全球6个主要数值模式的输出,通过机器学习分配权重。在2022年台风‘轩岚诺’预测中,TVCN的路径误差比单一模式降低40%,尤其对转向台风的预判能力显著增强。

未来之战:超算、AI与观测网的‘铁三角’

超算能力是数值预报的‘心脏’。当前,中国‘天河三号’、日本‘富岳’等E级超算(每秒百亿亿次计算)已能支持全球1公里分辨率的模拟。但真正突破在于‘自适应网格’技术:模型可动态加密台风核心区域网格,在保持计算效率的同时,将眼墙区分辨率提升至500米级。

AI与物理模型的深度融合成为新方向。华为盘古气象大模型通过引入三维卷积神经网络,在保持物理约束的同时,将全球模式计算时间从3小时压缩至10秒。更革命性的是‘可解释AI’技术,它能标识出预测结果中受哪些物理过程主导,帮助气象学家理解模型决策逻辑。

观测网的‘最后一公里’仍在突破。计划于2025年发射的‘风云五号’卫星,将搭载毫米波云雷达与高光谱红外仪,能穿透云层直接测量台风眼区温度结构。地面方面,中国沿海部署的3000个智能浮标,可实时传输海表温度、盐度与波浪数据,将海洋初始场误差降低30%。

台风预测的终极目标,是从‘被动追踪’转向‘主动干预’。通过数值模型模拟人工增雨对台风强度的削弱效果,或利用海洋上空的可控飞行器改变局部热力条件,这些曾属于科幻的设想,正随着模型精度的提升进入可行性研究阶段。